- Autorius Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:50.

- Paskutinį kartą keistas 2025-01-22 17:32.

Norėdami suaktyvinti „TensorFlow“, atidarykite „Amazon Elastic Compute Cloud“(„Amazon EC2“) DLAMI egzempliorių su „Conda“

- „TensorFlow“ir „Keras 2“sistemoje „Python 3“su CUDA 9.0 ir MKL-DNN paleiskite šią komandą: $ source activate tensorflow_p36.

- TensorFlow ir Keras 2 Python 2 su CUDA 9.0 ir MKL-DNN paleiskite šią komandą:

Atitinkamai, ar TensorFlow veikia AWS?

TensorFlow ™ leidžia kūrėjams greitai ir lengvai pradėti gilų mokymąsi debesyje. Tu gali pradėti AWS su visiškai valdoma TensorFlow patirtis su Amazon „SageMaker“, platforma, skirta kurti, mokyti ir diegti mašininio mokymosi modelius.

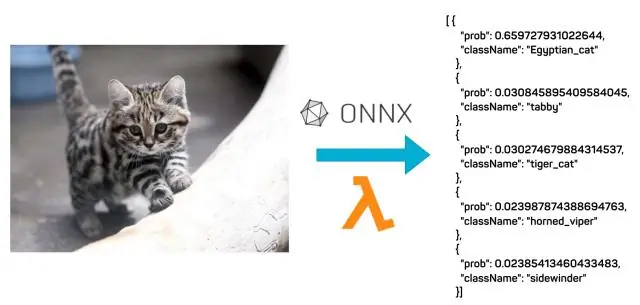

Taip pat žinote, kas yra AWS TensorFlow? Kategorija: Tensorflow įjungta AWS TensorFlow yra atvirojo kodo mašininio mokymosi (ML) biblioteka, plačiai naudojama kuriant sunkius giliuosius neuroninius tinklus (DNN), kuriems reikalingas paskirstytas mokymas naudojant kelis GPU keliuose pagrindiniuose kompiuteriuose.

Taip pat kyla klausimas, kaip paleisti AWS mašininį mokymąsi?

Pradėkite nuo gilaus mokymosi naudodami AWS Deep Learning AMI

- 1 veiksmas: atidarykite EC2 konsolę.

- 1b veiksmas: pasirinkite mygtuką Paleisti egzempliorių.

- 2a veiksmas: pasirinkite AWS Deep Learning AMI.

- 2b veiksmas: išsamios informacijos puslapyje pasirinkite Tęsti.

- 3a veiksmas: pasirinkite egzemplioriaus tipą.

- 3b veiksmas: paleiskite egzempliorių.

- 4 veiksmas: sukurkite naują privataus rakto failą.

- 5 veiksmas: spustelėkite Peržiūrėti egzempliorių, kad pamatytumėte egzemplioriaus būseną.

Kaip aptarnaujate TensorFlow modelį?

- Sukurkite savo modelį. Importuokite Fashion MNIST duomenų rinkinį. Išmokykite ir įvertinkite savo modelį.

- Išsaugokite savo modelį.

- Patikrinkite išsaugotą modelį.

- Patiekite savo modelį naudodami „TensorFlow Serving“. Pridėkite „TensorFlow Serving“platinimo URI kaip paketo šaltinį: Įdiekite „TensorFlow Serving“.

- Pateikite užklausą savo modeliui „TensorFlow Serving“. Pateikite REST užklausas.

Rekomenduojamas:

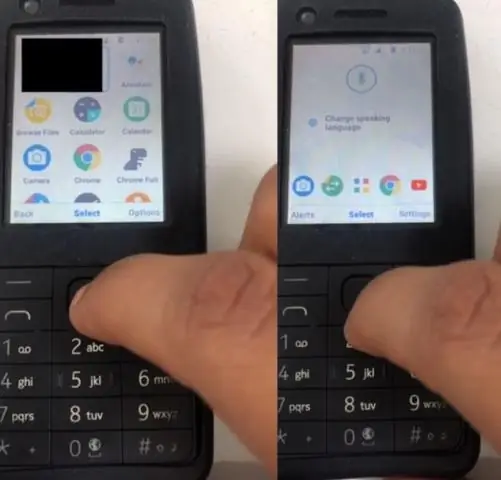

Kaip iš naujo paleisti „Nokia Android“telefoną?

Jei telefonas nereaguoja, galite atlikti „švelnią atstatymą“paspausdami garsumo didinimo klavišą ir maitinimo mygtuką vienu metu maždaug 15 sekundžių (arba kol telefonas suvibruos). Tada jūsų telefonas turėtų akimirksniu įsijungti iš naujo

Kaip iš naujo paleisti SCCM paslaugas?

Iš naujo paleiskite SCCM SMS_EXECUTIVE paslaugą naudojant paslaugų konsolę Paprasčiausias ir lengviausias būdas iš naujo paleisti SMS_EXEC paslaugą yra per paslaugų konsolę. Paleiskite paslaugų konsolę. Dešiniuoju pelės mygtuku spustelėkite SMS_EXECUTIVE paslauga ir spustelėkite Paleisti iš naujo

Kaip paleisti DAV failą?

Failai sukurti naudojant DVR įdiegtą SightBossCentralStation programinę įrangą. DAV vaizdo įrašus galima atkurti sistemoje Windows naudojant atskirą kompiuterio DVR365 grotuvo programinę įrangą. Atminkite, kad norėdami atidaryti a. DAV failą DVR365 grotuve, pirmiausia turite spustelėti atkūrimo mygtuką, kuris atidaro failo atidarymo dialogą

Kaip paleisti dokerio konteinerį AWS?

Įdiekite „Docker“konteinerius 1 veiksmas: nustatykite pirmąjį paleidimą naudodami „Amazon ECS“. 2 veiksmas: sukurkite užduoties apibrėžimą. 3 veiksmas: sukonfigūruokite paslaugą. 4 veiksmas: sukonfigūruokite savo grupę. 5 veiksmas: paleiskite ir peržiūrėkite savo išteklius. 6 veiksmas: atidarykite pavyzdinę programą. 7 veiksmas: ištrinkite savo išteklius

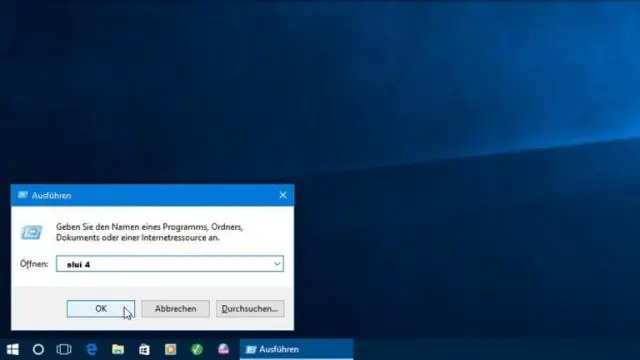

Ar galite paleisti „Windows“AWS?

Klientai daugiau nei dešimtmetį naudoja „Windows“darbo krūvius AWS. Galite pasirinkti iš daugybės „Windows Server“versijų, įskaitant naujausią „Windows Server 2019“versiją. Be to, AWS palaiko viską, ko reikia norint kurti ir paleisti „Windows“programas, įskaitant „Active Directory“